Un nuovo pericolo incombe nel Web. Non si tratta del solito fotoritocco applicato alle fotografie sulle riviste, ma di una tecnica, legata all’intelligenza artificiale, con cui si possono scambiare i volti di foto e video con una qualità a dir poco strabiliante.

L’intelligenza artificiale fa sempre più paura. E’ oggetto di studio e di applicazione di questi ultimi mesi un sistema che permette di scambiare e di sostituire i volti delle persone con altri, in modo pressoché impercettibile. Tramite l’apprendimento automatico, i visi delle persone possono essere sovrapposte o sostituite con quelli di altri individui, per dare luogo a scene e movenze con nuovi personaggi. Seriamente, come mai prima d’ora, l’identità è minacciata dalla tecnologia. Se da un lato tale continua ricerca contribuisce a rendere ancor più potenti le macchine, dall’altro si apre una nuova porta dalla quale possono intravedersi pericoli incombenti per tutti, primi tra tutti le persone famose, politici, cantanti, attori, ecc. Tramite il Deepfake, infatti, gli ignari VIP potrebbero ritrovarsi in scene a loro del tutto sconosciute e compromettenti. La controprova potrebbe risultare estremamente complicata, se non impossibile.

La tecnica

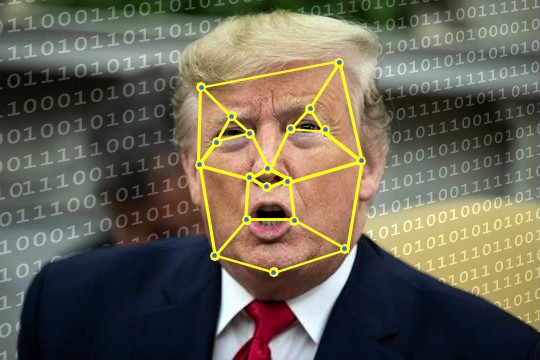

Analizzando milioni d’immagini (vedi in figura 1), i sistemi imparano a creare e a controllare video falsi, grazie all’intelligenza artificiale. Facebook ha recentemente fatto qualcosa di simile, usando attori per costruire video falsi e poi rilasciandoli a ricercatori esterni. Grazie a una rete neurale artificiale, la potenza del processore e molta memoria operativa, il software scandaglia tra milioni di immagini di volti, create all’uopo in diverse posizioni, movenze, ed espressioni di qualunque genere. Sarà poi il programma a sovrapporre, in maniera perfetta, la nuova personalità a quella originale, creando personaggi mai visti prima o, viceversa, proiettare soggetti estremamente noti in luoghi e situazioni del tutto nuove o socialmente rischiose. I modelli base vengono creati da riprese di attori e controfigure, immortalati durante azioni di tutti i giorni (parlare, ridere, girare il volto, ecc). La potenza dell’hardware e del software fa tutto il resto.

Figura 1: la tecnica di Deepfake utilizza milioni di immagini per cambiare volto

I software

Assieme alla sperimentazione cammina parallelamente la via dei test, con i quali molti soggetti vengono presi come campione per valutare i filmati prodotti e capire se ciò che hanno appena visto costituisce una realtà oppure, appunto un fake. La maggior parte delle persona non sa rispondere o sentenzia in modo errato.

I pericoli

Si comprende subito come l’identità delle persone, specialmente quelle più in vista, sia messa in serio pericolo. La possibilità della diffusione di un video falso sulle piattaforme pubbliche più note e conosciute è tutt’altro che remota. S’immagini, ad esempio, Donald Trump improvvisare un comico balletto o un noto personaggio dello spettacolo intento a battersi in una furiosa ma inesistente rissa o il Papa in posizioni compromettenti (vedi figura 2). Si tratta di un panorama di cui, certamente, si sentirà parlare nell’immediato futuro. E, come al solito, l’innovazione sarà utilizzata anche da soggetti o organizzazioni malavitose, con conseguenti danni per le persone oneste. Uno scenario inquietante che impone, al più presto, strette misure di controllo e di sorveglianza da parte di tutti gli organi preposti. E i pericoli sono ancor più evidenti se si pensa al fatto che in rete esistono miliardi di immagini e fotografie di volti che possono essere utilizzati per gli esperimenti e le manipolazioni.

Figura 2: un video Deepfake del Papa

Le soluzioni

Con la tecnologia attuale risulta difficile, se non impossibile, discriminare le scene reali da quelle modificate e ritoccate. L’intelligenza artificiale applica alla perfezione modelli e camuffa bene i ritocchi che le differenze risultano, praticamente, naturali.

Conclusioni

Le tecnologie utilizzate per creare i Deepfakes sono ancora nuove e sperimentali e, spesso l’uomo riesce a notare le imperfezioni. Ma la tecnologia si sta evolvendo di giorno in giorno e ben presto il genere umano non sarà più in grado di tenere il passo con l’intelligenza artificiale. La battaglia è già iniziata tra i creatori dei Deepfakes e i programmatori di software per identificare, scovare e rimuovere i falsi video. Proprio come virus e antivirus lottano tra loro già da parecchi anni.